Şirket yaptığı açıklamada, Apple’ın ABD’de iCloud’a yüklenen çocuk istismarı görüntülerini kolluk kuvvetlerine bildireceğini söyledi. Sistem test edilmeye başlandı ama ABD’de iOS 15 güncellemesine kadar herkes dahil olamayacak.

Yeni sistem, görüntülerin o görüntüye karşılık gelen benzersiz sayılara dönüştürüldüğü hashing adı verilen bir işlem kullanarak Çocuk Cinsel İstismarı Malzemesi (CSAM) olarak adlandırılan görüntüleri tespit edecek. Böylece Apple, çocuk istismarı görüntüleri de dahil olmak üzere hizmet şartlarını ihlal eden içerik için, genellikle hashing sistemlerini kullanan kullanıcı dosyalarını halen tarayan diğer bulut hizmetleriyle aynı düzeye gelmiş oluyor.

Apple sistemin kullanıcılar için gizliliği arttırdığı iddiasında. Çünkü hem sunucularında hem de kullanıcı cihazlarında karmaşık şifreleme kullanıyor ve gerçek görüntüleri taramadığını kaydediyor.

Ancak, mahremiyete duyarlı birçok kullanıcı, hükümetleri bir cihazdaki veya buluttaki içerikler hakkında bilgilendiren yazılımlardan hala çekiniyor ve özellikle Apple cihaz şifrelemesini şiddetle savunduğundan ve ifade özgürlüğünün daha az olduğu ülkelerde çalıştığından, bu duyuruya olumsuz tepki verebilir.

Dünyanın dört bir yanındaki kolluk kuvvetleri de, çocuk istismarını veya terörizmi araştırmak amacıyla iMessage ve iCloud gibi diğer yazılım hizmetleri için şifrelemesini zayıflatması için Apple’a baskı yaptı. Apple ise kullanıcı gizliliği konusundaki mühendislik ilkelerinden bazılarından vazgeçmeden bu sorunu böyle çözmeye çalışıyor.

Nasıl çalışıyor

Bir görüntü Apple’ın iCloud’unda saklanmadan önce, Apple, görüntünün karma değerini Ulusal Kayıp ve İstismara Uğramış Çocuklar Merkezi (NCMEC) tarafından sağlanan karma veri tabanıyla eşleştiriyor. Bu veritabanı, iOS 15 güncellemesinden başlayarak iOS kodunda dağıtılacak. Apple, eşleştirme işleminin bulutta değil, kullanıcının iPhone’unda yapıldığını söyledi.

Apple daha sonra bir iCloud hesabında belirli sayıda ihlal eden dosya tespit ederse, sistem Apple’ın şifresini çözmesine ve bu hesaptaki görüntüleri görmesine izin veren bir dosya yüklüyor. Kişi, eşleşme olup olmadığını doğrulamak için görüntüleri manuel olarak inceler.

Apple, yalnızca zaten bilinen ve bu veritabanlarına bildirilen içerikle eşleşen görüntüleri inceleyebilecek; örneğin, bu görüntüler NCMEC veritabanı bir parçası olmayacağından, ebeveynlerin çocuklarının banyodaki fotoğraflarını almayacak.

Manuel incelemeyi yapan kişi, sistemin hata yapmadığı sonucuna varırsa, Apple kullanıcının iCloud hesabını devre dışı bırakır ve gerekirse NCMEC’e bir rapor gönderir veya kolluk kuvvetlerini bilgilendirir. Bir Apple temsilcisi, hesaplarının yanlışlıkla işaretlendiğini düşünürlerse, kullanıcıların Apple’a itirazda bulunabileceklerini söyledi.

Apple, sistemin yalnızca iCloud’a yüklenen ve kullanıcıların kapatabileceği görüntüler üzerinde çalıştığını söyledi. Apple sunucularına yüklenmemiş bir cihazdaki fotoğraflar veya diğer resimler sistemin parçası olmayacak.

Bazı güvenlik araştırmacıları, bu teknolojinin sonunda siyasi protesto fotoğrafları gibi başka tür görüntüleri tanımlamak için kullanılabileceğine dair endişelerini dile getirdiler. Apple, sisteminin yalnızca çalışacak ve yalnızca NCMEC veya diğer çocuk güvenliği kuruluşları tarafından kataloglanan görüntülerle çalışabilecek şekilde oluşturulduğunu ve kriptografiyi oluşturma biçiminin başka amaçlar için kullanılmasını engellediğini söyledi.

Apple, veritabanına ek hash ekleyemeyeceğini söyledi. Apple, kullanıcı gizliliğinden ödün vermeden yasa dışı çocuk istismarı görüntülerini tespit edebildiğini onaylamak için sistemini kriptografi uzmanlarına sunduğunu söyledi.

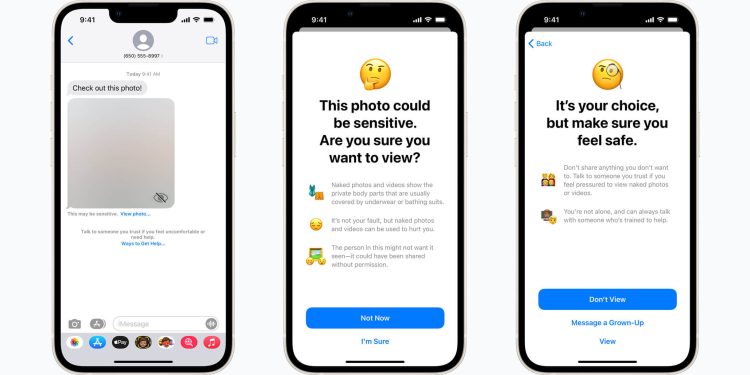

Apple, çocukları yırtıcılardan korumayı amaçlayan diğer özelliklerle birlikte açıkladı. Ayrı bir özellikte Apple, çıplaklık içerebilecek görüntüleri bulanıklaştırmak için bir aile hesabı olan bir çocuğun iPhone’unda makine öğrenimini kullanacak ve ebeveynler, 13 yaşından küçük bir çocuk iMessage’da cinsel içerik aldığında uyarılmayı seçebilir. Apple ayrıca Siri’yi çocuk istismarının nasıl bildirileceğiyle ilgili bilgilerle güncelledi.

[1] Expanded Protections for Children

Kaynak :

Kaynak :